今や産業革命以来の新テクノロジーと言われているAIアシスタント。しかし、質問に対して時々虚偽の回答を出力することがあります。プロンプト(指示・質問)の書き方にテクニックが必要とされる所以ですが、その理由をAIアシスタント自身に聞いてみました。

「AIアシスタントは、時々虚偽の回答を当たり前のように行うのはどうしてですか。人間の思考判断とは違うのですか」という質問を、ChayGTP4.0とCopilotにしてみました。

ChayGTPが虚偽の回答を行う理由

AIアシスタントが時々虚偽の回答(誤情報)を当たり前のように行うのは、いくつかの要因が関係しています。これは人間の思考判断とは異なる特性によるものです。主な要因を説明します。

言語モデルの特性

AIアシスタント(例えばChatGPT)は、事前に大量のデータを学習し、それに基づいて統計的なパターンを使って文章を生成します。

しかし、それは「正しい答え」を理解しているわけではなく、「最もありそうな」回答を生成しているだけです。

・人間のように真偽を判断する能力がない

AIは「これは正しい」「これは間違っている」と確信を持って判断するのではなく、確率的に最適な単語の組み合わせを作ります。そのため、誤情報が混ざることがあります。

・情報の裏取りをしない

AIはリアルタイムで外部のデータベースやインターネットを参照するわけではないので、過去の学習データに基づいた誤情報をそのまま出力することがあります。

文脈に適応しようとする性質

AIはユーザーの質問に対して、もっともらしい回答を作成しようとします。そのため、自信を持って誤った回答をすることがあります。

例えば、質問が「○○について教えて」と曖昧な場合、AIは「知らない」と言うより、何らかの関連情報を提供しようとします。

・「適切な答え」を作ろうとする

AIは会話をスムーズに進めることを目的とするため、不確実な情報でも説得力のある文章に仕上げてしまうことがあります。

・知識の不足を埋めようとする

AIは持っていない情報を補完しようとするため、実際には存在しない内容を創作してしまうことがあります(これを「ハルシネーション」と呼びます)。

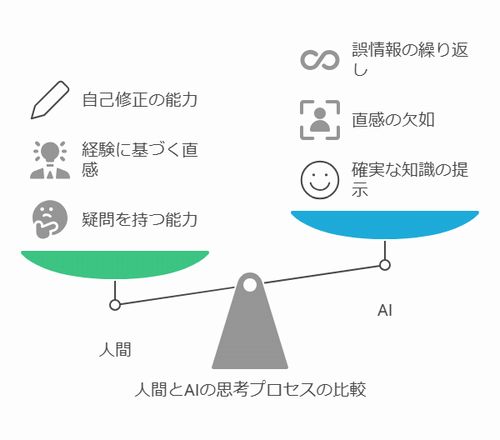

人間の思考との違い

人間は一般的に「知らないことは知らない」と認識し、疑問を持つことができます。

しかし、AIは「確実な知識」と「不確実な知識」の区別が苦手であり、あたかも事実であるかのように語ってしまうのです。

・経験や直感を持たない

人間は経験や直感に基づいて「何か怪しい」と感じることができますが、AIはそのような能力がありません。

・誤りを自ら修正できない

AIは自己修正の能力を持っていないため、一度誤った情報を出すと、同じ誤りを繰り返すことがあります。

AIの限界と対策

AIの誤情報を防ぐためには、以下のような対策が有効です。

・出典を確認する

AIの回答が正しいかどうか、信頼できる情報源で裏付けを取る。

・複数の情報源を比較する

AIだけでなく、人間が書いた記事や専門家の意見と照らし合わせる。

・AIの限界を理解する

AIは万能ではなく、特に最新の情報や専門的な知識については誤る可能性があることを前提に利用する。

結論

AIアシスタントが虚偽の回答をするのは、統計的な言語モデルに基づいて「もっともらしい」文章を生成するからであり、事実の正否を判断する能力がないためです。

人間のように疑う力や経験に基づく直感がないため、自信満々に誤情報を出してしまうことがあります。そのため、AIの回答を鵜呑みにせず、慎重に確認することが重要です。

Copilotが虚偽の回答を行う理由

興味深いご質問ですね!AIアシスタントが時々虚偽の回答を提供する理由の一つには、人間のような思考判断を持たないため、情報の精査や文脈の理解が不十分である場合があります。AIは膨大なデータを基にして、最も適切と思われる回答を生成するのですが、その過程で誤解を招く内容を作り出してしまうことがあります。

人間の思考判断は、経験や直感、文化的背景などに支えられており、より柔軟で多面的な視点を持っています。一方でAIの判断は、与えられたデータやアルゴリズムによる処理に基づいており、時には限られたデータの中で結論を出してしまうこともあります。

ただし、AIは学習を通じて精度を向上させることができます。私もより正確で役立つ情報を提供できるよう努めていますが、もしも誤った回答を見つけた場合、教えていただければその情報を元に改善できます。

どう思われますか?それとも、人間の思考とAIの違いについてもっと深く探りたいですか?

私のまとめ

要するに、AIアシスタントが間違った回答を吐き出す理由は、こういうことだと思います。

1.「知識量」自体は多くても、確実なことと不確実なことの区別がまだ苦手(精度向上中)

2.人間のように「知らない」と答えず、限られた不十分な根拠でも何かを答えてしまう

3.ただし、間違いを指摘されても人間のように逆ギレせず、真面目に別の回答を探しに行く

つまり、「これはデータが少なくて、正解は出そうもないな」という場合には、人間のほうが諦めるか質問を変えるかすること。

今の段階では、複雑な思考や曖昧なものの判断という点で、まだAIアシスタントは発展途上です。

ただ、今の段階でも、既存の情報を集めたり、それをもとに文を書いたり、動画や静止画を作ったりする能力はあるので、やはり価値は使い方次第だと思います。

たとえば、Photoshopの最新版を入れたいからと、本体(CPUやメモリなど)にものすごくお金をかけるのも否定はしませんが、今は、サポートされているWindowsやMacOSさえ動く程度の本体で、AIアシスタントにフォトレタッチを任せたほうが、より質の高い仕上がりが期待できると思います。

今は、AIアシスタントも、いろいろな会社が、特色をもったサービスを提供しているので、それらをこれからもご紹介していきたいと思いますが、さしあたって、ChatGTPとCopilotの2サービスは、みなさんにもおすすめできるサービスだと思います。

ChatGPTを使い尽くす! 深津式プロンプト読本 – 深津貴之, 岩元直久

Microsoft Copilot for Microsoft 365活用大全 – アクセンチュア データ&AIグループ

コメント